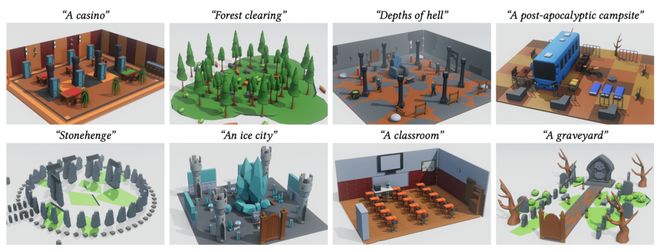

随着生成式 AI 的快速发展,从文本生成图像、视频,到构建完整的三维世界,AI “创造空间” 的能力正以前所未有的速度突破边界。然而,现有 3D 场景生成方法仍存在明显局限:模型往往直接输出每个物体的几何参数(位置、大小、方向等),结果容易出现漂浮、重叠、穿模等问题;场景结构缺乏逻辑一致性,难以编辑或复用,更无法像程序那样精确控制空间关系与生成逻辑。

想象这样一个画面:你输入一句话 ——

“在黄昏的码头上,一位渔夫坐在木椅上,旁边是一盏摇曳的灯。”

AI 不再只是 “摆放” 这些元素,而是生成一段可执行的三维构建脚本:从灯光的照射角度到渔夫与木椅的相对位置,都由程序逻辑自动推导与控制。

这种 “从语言到程序再到场景” 的新范式,正是由布朗大学(Brown University)与加州大学圣地亚哥分校(UC San Diego)的研究团队提出的 Procedural Scene Programs(PSP) 框架。

与传统的几何直接生成方法不同,PSP 让 AI 不再是 “画” 出一个世界,而是像程序员一样 “写” 出世界的生成逻辑。模型输出的不是静态的三维网格,而是一段可运行的场景脚本,具备高度的可编辑性、可复用性与结构可控性—— 为 AI 世界构建带来了新的语言与思维方式。

该研究已被计算机图形学顶会 SIGGRAPH Asia 2025 接收。