纽约大学的研究团队通过QSVD的新方法,让视觉语言模型(VLM)实现了惊人的效率飞跃,在普通GPU上获得了高达13.1倍的运行速度提升。

视觉语言模型是人工智能领域的一项杰出成就,它赋予了AI像人一样同时理解图像和文字的能力。

无论是让AI看图说话,进行生动的图像描述,还是回答关于一张图片内容的复杂问题,这些都离不开VLM的核心支持。

它就像是连接视觉世界和语言世界的桥梁,在医疗诊断、在线教育、互动娱乐等众多领域展现出巨大的应用潜力。

然而,这种强大的能力背后,是巨大的计算代价。

VLM需要吞噬海量的数据,处理高维度的视觉与文本信息,这导致其模型体积庞大,内存占用极高,计算过程缓慢。

尤其是在模型进行推理,也就是生成答案或描述时,一个名为键值缓存(KV Cache)的机制会急剧消耗内存带宽,成为拖慢整体速度的主要瓶颈。

这种高昂的硬件成本,极大地限制了VLM在普通设备,特别是手机、笔记本电脑等资源受限环境中的部署和应用。

为了让这项技术真正走进千家万户,科学家们必须为这头巨兽瘦身减负,在不牺牲其智慧的前提下,让它变得更轻、更快。

奇思妙想:将Q、K、V三个矩阵捆绑处理

过去,研究者们尝试了各种方法来压缩模型,比如分组查询注意力或多查询注意力,思路主要是减少计算中的某些环节。

最近,DeepSeek-v3模型提出的多头潜在注意力(MLA)提供了一个新颖的视角,它通过将KV缓存压缩成更小的潜在向量,显著提升了推理效率。

受到MLA的启发,纽约大学的研究者们提出了一个更大胆的想法。

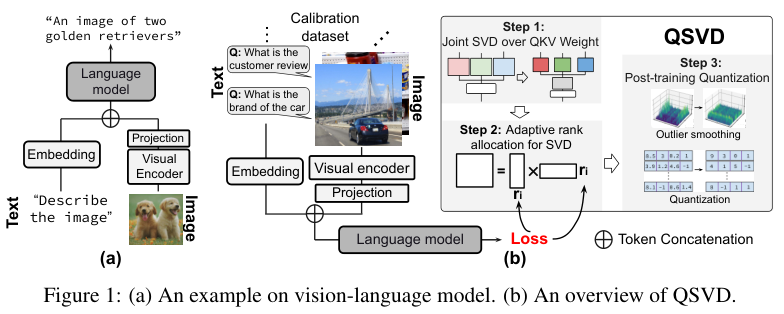

在VLM的核心组件多头注意力(Multi-Head Attention)模块中,输入的信息会通过三个独立的权重矩阵,分别变换成查询(Query, Q)、键(Key, K)和值(Value, V)。

这三个元素是注意力机制的关键,决定了模型在处理信息时应该关注什么。

传统的优化方法,通常是独立地去压缩处理Q、K、V各自的权重矩阵。这就像是三个独立的优化任务,分别对三个部件进行改造。

而QSVD的核心创新在于,它不再将这三者分开看待。

研究团队将原本独立的三个大小为E×E的权重矩阵WQ、WK、WV,在逻辑上拼接成一个更宽的、大小为E×3E的联合矩阵Wconcat。

然后,他们对这个拼接后的超级矩阵进行一次统一的奇异值分解(Singular Value Decomposition, SVD)。

SVD是一种经典的矩阵分解技术,可以理解为一种精密的数据压缩手术。

它能将一个复杂的矩阵,分解为几个更简单、更小的矩阵相乘的形式,并自动找出原矩阵中最重要的特征信息,用一个对角矩阵中的奇异值来表示其重要性,数值越大的奇异值越重要。

通过保留那些最重要的奇异值,就可以用几个小得多的矩阵来近似模拟原来的大矩阵,从而实现压缩。

QSVD的这一步操作,带来了立竿见影的好处。